meta发布新模型_Emu Video怎么使用_Emu Video下载地址

随着扩散模型的飞速发展,诞生了Midjourney、DALL·E 3、Stable Difusion等一大批出色的文生图模型。但在文生视频领域却进步缓慢,因为文生视频多数采用逐帧生成的方式,这类自回归方法运算效率低下、成本高。

即便使用先生成关键帧,再生成中间帧新方法。如何插值帧数,保证生成视频的连贯性也有很多技术难点。

科技、社交巨头Meta则提出了一种全新的文生视频模型Emu Video。该模型使用了分解式生成方法,先生成一张图像,再以该图像和文本作为条件生成视频,不仅生成的视频逼真符合文本描述,算力成本也非常低。

论文:https://emu-video.metademolab.com/assets/emu_video.pdf

-

meta发布新模型_Emu Video怎么使用_Emu Video下载地址

随着扩散模型的飞速发展,诞生了Midjourney、DALL·E 3、Stable Difusion等一大批出色的文生图模型。近日社交巨头Meta则提出了一种全新的文生视频模型Emu Video。该模型使用了分解式生成方法,先生成一张图像,再以该图像和文本作为条件生成视频,不仅生成的视频逼真符合文本描述,算力成本也非常低。

2025-03-25 17:12:24 -

开源AI图生视频_Animate Anyone:一张图片生成一段毫无破绽的舞蹈视频

分享一个超级厉害的开源AI项目——Animate Anyone,只需要一张图片和一些姿势指导,就可以为任何人快速制作视频或直播。它可能会部分甚至完全改变短视频 直播领域。

2025-03-25 16:43:44 -

Stability AI发布图像生成AI视频大模型Stable Video Diffusion,可生成4秒短视频

知名在线AI图像生成开发商Stability AI又发布了旗下最新的 AI 大模型 ——Stable Video Diffusion。这款模型能够让图像生成视频。

2025-03-25 16:15:37 -

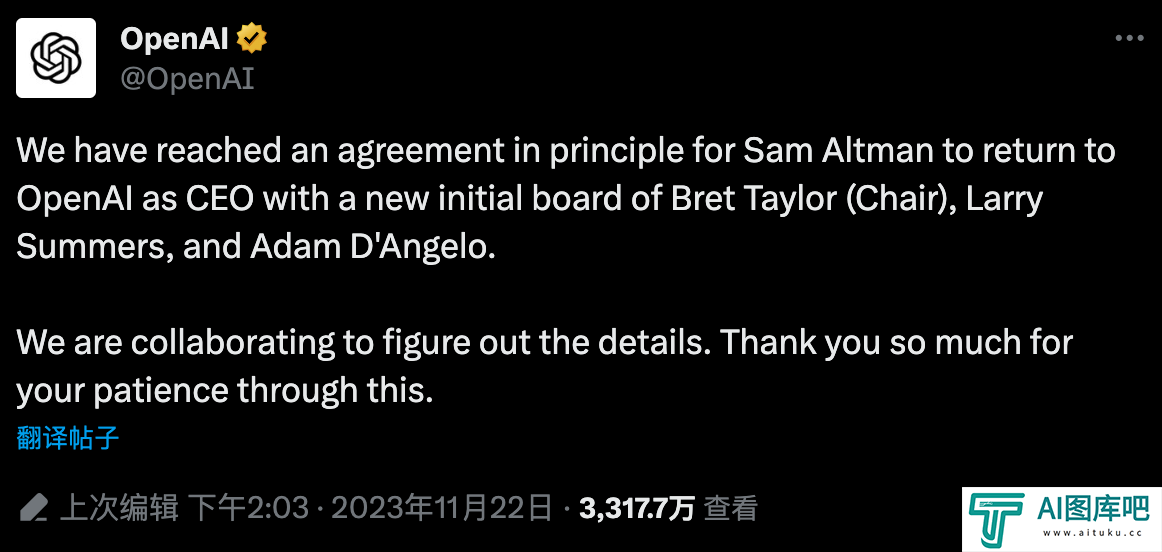

奥特曼重新出任OpenAI CEO丨Claude发布2.1版本更新,Token超越GPT-4丨马斯克Grok AI大模型开启内测

【AI奇点网2023年11月23日早报】本站每日播报AI业界最新资讯,触摸时代脉搏,掌握未来科技动向。事不宜迟,点击查看今日AI资讯早餐。

2025-03-25 15:51:06 -

copilot将在12月1日发布_微软copilot在中国推出_最新资讯

微软将在今年12月1日面向中国大陆的企业和教育机构推出,基于网页的生成式AI聊天助手 ——Copilot(曾用名Bing Chat Enterprise)。

2025-03-25 15:25:51 -

飞书AI助理_飞书智能伙伴怎么使用_官方申请入口

飞书在北京举办了AI新品发布会,正式发布“飞书智能伙伴”等系列AI产品。“飞书智能伙伴”有知识、有记忆,有主动性,也能深入到业务中。

2025-03-25 15:04:15

-

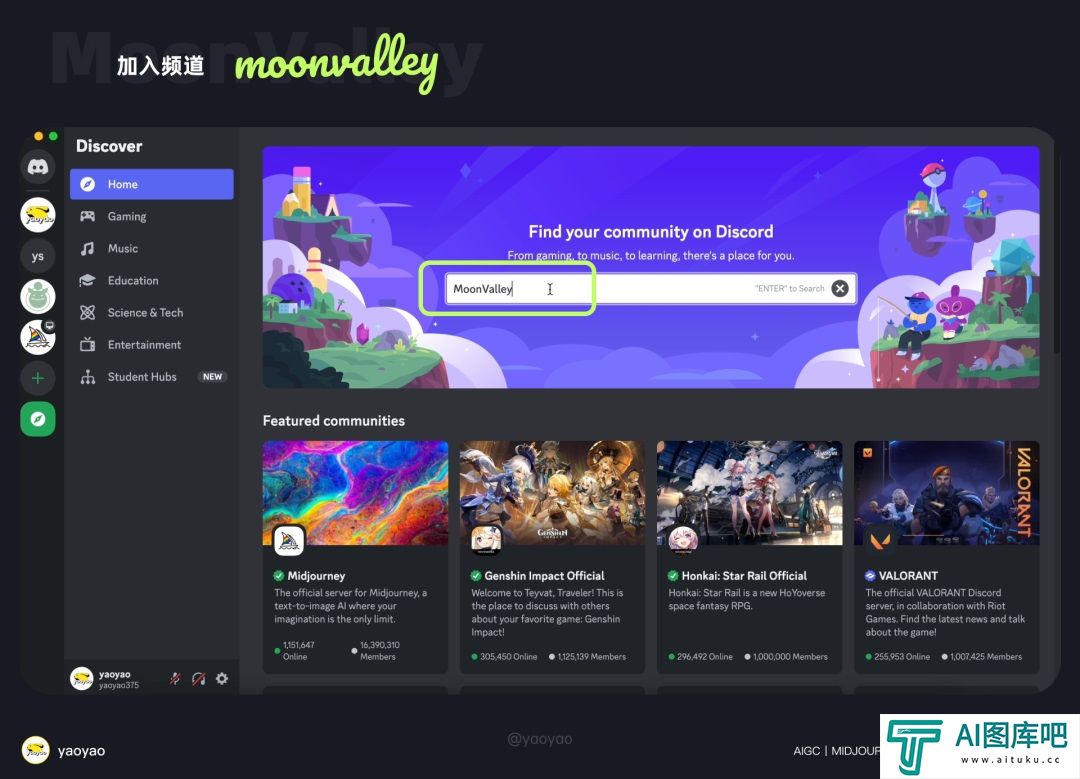

MoonValley使用教程_AI视频怎么生成

本文为大家介绍一款视频生成 AI 工具 Moonvalley,只需简短的提示词,即可产生 16:9 的电影质感片段。接下来让我们来试一试吧。

2024-12-18 12:06:09 -

AI视频后期消除对象神器ProPainter:一涂一抹,视频轻松移除指定对象丨本地离线一键部署

今天给大家介绍一款超强的一键删除视频内的移动物体和去除视频水印的工具ProPainter。本地部署比较麻烦,已经为大家制作好了离线整合包,解压即用。

2024-12-19 17:43:32 -

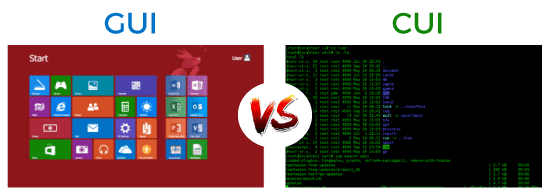

你已经是个“成熟的AI”,可以帮我代肝了:智谱AI联合清华大学团队打造视觉大模型CogAgent:可提供《原神》教学辅助

日,清华大学与旗下孵化的人工智能创企智谱AI合作,联合推出了新一代视觉GUI Agent图像理解大模型 CogAgent,可告知《原神》游戏操作步骤等

2025-02-20 17:54:39 -

AI代理将主导2025年,而不是ChatGPT

很多人工智能专家和预测者都认为,今年该领域最大的趋势之一是 AI 代理,它与 Claude 或 ChatGPT 等生成式 AI 模型不同。AI 代理也不同于定制 GPT。以下是它们各自的主要区别。 生成式 AI: 专注于根据用户输入创

2025-02-21 09:08:08 -

OPPO公布AndesGPT大模型最新升级:70亿参数端侧模型,OPPO Find X7系列首发搭载,小布助手能力全面提升

在会上,OPPO 公布了自研的”安第斯大模型“ AndesGPT 的全新升级,为行业内”首个端侧应用70亿参数大模型“的手机厂商。

2025-02-21 09:08:06 -

两次走出低谷后,人工智能正重新占据舞台中心

2月16日早上,王祚的手机里收到了一条公众号推送,文章标题直白且不加掩饰——“现实,不存在了。” 这句看似从科幻小说《三体》中借鉴来的标题吸引了王祚,出于好奇,他打开了这篇推文。文章中讲述的是美国开放人工

2025-02-21 09:35:08 -

银河证券:DeepSeek的技术颠覆带来的是AI行业的多元化,有望加速AI行业的普及繁荣

每经快讯,银河证券研报认为,DeepSeek通过算法及工程创新,显著降低成本。结合银河证券对芯片、硬件、软件、应用端等的影响分析,DeepSeek的技术颠覆带来的是AI行业的多元化,有望加速AI行业的普及繁荣。建议关

2025-02-21 13:40:54 -

超越人类认知边界!AI设计的芯片太复杂:科学家也看不懂

快科技2月4日消息,随着AI的快速发展,部分科学家开始借助AI设计芯片,然而AI设计的部分芯片过于复杂,甚至超出人类的理解范畴。 普林斯顿大学Sengupta实验室的科学家团队主导了这项研究,他们通过“逆向设计”

2025-02-21 14:30:37 -

人类终将一败涂地?谷歌被曝出年末再次大裁员:3万名员工面临被AI所取代

据外媒报道,继1 2万大裁员之后,谷歌又计划重组广告销售部门——这将导致3万名员工面临裁员的风险。科技行业从年头裁到了年尾,还越裁人越多了。

2025-02-21 16:30:50 -

谷歌Gemini自称文心一言?!一个BUG牵出AI大模型重大难题:全球陷入高质量训练数据荒,2024年或将枯竭

当地时间12月22日,外网内网的网友们激动地奔走相告:Gemini承认自己是用文心一言训练中文语料的。这听起来就是个段子,简直魔幻。

2025-02-21 16:58:14