Stable Diffusion的ControlNet模型测评_stable diffusion模型_stable diffusion最新更新

千呼万唤始出来!就在昨天,WebUI的ControlNet1.1.4版本终于更新,这次的更新支持了SDXL1.0的模型。我怀着兴奋的心情,打开了网站开始下载模型。这次总共出了四种控制类型,分别是Canny、Depth、Sketch和Openpose。

来到Hugging Face的网址:https://huggingface.co/lllyasviel/sd_control_collection/tree/main。可以看到这里有相当多的模型,当然,我们不需要全部都下载下来,因为它们之间有很多功能是重复的,是不同的作者做出来的。

但是呢,为了帮你们提前踩雷,我把他们全部都下载了,而且逐个做了测试,看到我这么辛苦的份上,你们一定会要给我一个“点赞”和“在看”的吧。

接下来,让我们来分类看一下吧。

#Canny硬边缘

首先是canny,它有几个不同的型号,体积越大,速度越慢。

我使用的是4080ti的笔记本进行的测试,12G显存。

模型sdxl base+refiner

提示词:masterpiece,best quality,1girl

采样方法:euler a

尺寸1024*1024

使用diffusers的2.5Gfull模型绘制的图片,一张图花了2分57秒,从这个效率上来看,这个大尺寸基本可以弃了。

使用diffusers的320Mb的small模型,用时34s,质量上差距不大,主要是时间优势很明显。

我们可以再看看其他作者的,这张是kohya的,用时33秒,更接近真实质感。

sai的canny分为128lora和256lora,分别用时39秒和1分08秒,这个模型比较偏绘画的感觉。

最后还有一个t2i的canny模型,用时34s,也是偏插画一点。

你们觉得哪个效果更好呢?时间上基本都在30秒以上,如果关掉refiner的话,能节省一半左右的时间,平均在17秒左右。

#Depth深度

接下来测试一些depth模型,图形尺寸664*1024.

使用diffusers的full模型,用时2分48秒,sdxl给我随机到了一个拼贴画的风格。

使用diffusers的small模型,用时23s。

使用kohya模型,用时42秒。这……好像和我的图片没什么关系。

使用sai模型,用时1分12秒,画质还可以,稍微有点慢。

使用sargezt模型,奇奇怪怪,没什么关系,用时1分52秒。

# Sketch草图

接下来测试一下sketch模型,画一只可爱的小猫,图形尺寸1024*624.

使用kohya模型,用时30秒,这是个啥???

使用sai模型,没找到小猫具体的位置,用时32秒,画质还可以。

使用t2i模型,用时28秒,唯一一个准的。

# Openpose骨架

最后测试一下openpose模型,图形尺寸1024*624.

使用kohya模型,画很好看,但姿势不对,用时40秒。

使用thibaud模型,动作有那么点意思了,但是时间太慢了,用时2分12秒。

#总结

最后说下结论吧,没有权威性,全凭主观感受。

在canny模型中,我推荐使用“diffusers_xl_canny_small”,出图快,效果也还不错;depth模型中,我推荐使用“diffusers_xl_depth_small”,理由同上,其实“sai_xl_depth_128lora”效果也不错,但是渲染时间太长了,当然这个不是模型的问题,是我的问题,因为我买不起那么好的电脑;Sketch模型中,我推荐使用“t2i-adapter_xl_sketch”,这是腾讯家出品的,起码还挺还原的;openpose模型中,推荐“thibaud_xl_openpose_256lora”,虽然它画的不太准,但是它时间短啊,唉。。。

以上就是对sdxl的controlnet在webUI中表现的测评。虽然我的测评并没有很严谨(客观原因还是sdxl对机能的要求太高了),但是总体的成功率感觉还是太低了。而且因为sdxl模型支持多种画风,所以在我的提示词中并没有给出具体要求的情况下,controlnet的结果是千变万化的。

扫一扫,关注作者公众号

stable diffusion、Blender等学习心得分享

-

小度全新AI硬件将于百度世界大会发布丨智谱AI、即梦AI上线新一代视频生成模型丨OpenAI安全系统团队负责人离职

【AI奇点网2024年11月11日早报】本站每日播报AI业界最新资讯,触摸时代脉搏,掌握未来科技动向。事不宜迟,点击查看今日AI资讯早餐。

2025-01-08 11:46:33 -

字节跳动内测豆包通用图像编辑模型SeedEdit丨Grok聊天机器人免费版内测丨月之暗面Kimi创始人被提起仲裁

【AI奇点网2024年11月12日早报】本站每日播报AI业界最新资讯,触摸时代脉搏,掌握未来科技动向。事不宜迟,点击查看今日AI资讯早餐。

2025-01-08 11:25:01 -

李彦宏:文心大模型日调用量超15亿丨百度发布文心「iRAG」文生图技术丨小度AI智能眼镜发布,搭载大模型边走边问

【AI奇点网2024年11月13日早报】本站每日播报AI业界最新资讯,触摸时代脉搏,掌握未来科技动向。事不宜迟,点击查看今日AI资讯早餐。

2025-01-08 10:58:46 -

巧妙利用这两个AI产品,让你的国庆出行没有废片

这两天就有朋友来问我,有没有那种能修图的AI,就是扩图+消除啥的傻瓜好用的。大家大概的需求总结一下其实就两,AI消除+AI扩图。

2025-01-08 10:34:49 -

OpenAI初步谈妥融资70亿美元:最大金主微软追加投资10亿,苹果退出

据华尔街日报报道,苹果公司退出了对 OpenAI 的新一轮融资谈判,而微软则计划向 OpenAI 追加约 10 亿美元的投资。

2025-01-08 10:14:21 -

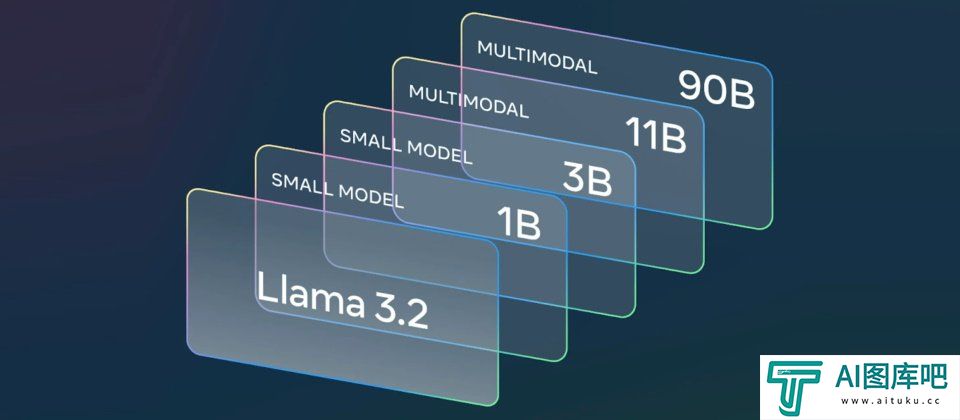

详解Meta全新大模型Llama 3.2系列:多模态视觉识别能力媲美OpenAI GPT-4o

Meta公司推出了Llama 3 2,也是它首款能够理解图像和文本的旗舰视觉模型。包含中型和小型两个版本,以及更轻量化可用于手机端侧的纯文本模型。

2025-01-08 09:46:43

-

怎么快速给模特换装_怎么用stable diffusion给模特换装

本篇教程主要运用StableDiffusion这个工具来进行操作,下面会通过几个小案例,给大家展示不同需求下,我们该如何使用StableDiffusion来辅助我们完成服装效果展示。本教程适用于电商设计场景、摄影场景等多个运用人物设计的实战中

2024-12-23 13:57:15 -

万万没想到,兵马俑都开始跳「科目三」:阿里云通义千问APP打造“全民舞王”视频创作工具,实测效果大赞

兵马俑跳《科目三》,是我万万没想到的。有人借助了阿里云之前走红的AI视频生成技术——「Animate Anyone」,生成出来了这个舞蹈片段。

2024-12-13 16:46:26 -

AIGC落地实践!四招帮你快速搞定运营设计

回顾这一年,随着 AIGC 浪潮的爆发,在掌握AI工具已经成为设计师必备技能。今天这篇文章,通过三个案例流程拆解带大家从新时代设计工作流,到必备「四大招式」,到图标设计六大方向,到训练专属模型,再到全流程手把手拆解设计项目,绝对干货满满

2024-12-18 16:57:17 -

ChatGPT怎么本地登录_GPT怎么使用_GPT本地项目

本期就ChatGPT的这次更新再次将完全新人使用指南提上日程,并对此次更新做些设想和想象。希望大家喜欢!

2024-12-19 07:41:20 -

stable diffusion初识_stable diffusion跟其他工具有什么区别]

关于Stable Diffusion的内容很多,在本篇教程里,我会先为你介绍Stable Diffusion模型的运行原理、发展历程和相较于其他AI绘图应用的区别。

2024-12-24 13:45:31 -

PikaAI怎么用_PIkaAI怎样生成视频_AI视频生成器Pika怎么用_AI视频生成工具Pika教程

Pika这款工具7月份在AIGC界横空出世,被圈内誉为目前“全球最好的文本生成视频AI工具”之一,也被认为是另外一款知名AI视频生成工具Runway的强有力挑战者。

2024-12-25 13:35:53 -

如何使用 ChatGPT 调试代码

当您的代码出现问题时,您可以向 ChatGPT 提供故障代码和问题描述。AI 工具将尝试识别并纠正问题。

2024-12-31 12:01:41 -

stable SR脚本安装_stable diffusion脚本网站

上节课我们讲的4xUltraSharp是不是觉得已经很强了! 那么如果我拿出Stable SR脚本你应该如何应对呢?

2024-12-31 13:49:18 -

零基础2天速成!白嫖「秋叶」官方AI绘画课程,卷死同事

和「秋叶」一起学AI绘画,掌握Stable Diffusion、Midjourney的使用方法,开展AI绘画副业,搞钱!?

2024-12-17 12:53:01 -

openpose如何自定义角色_个性化角色姿势怎么定制_Controlnet深度解析

在设计角色姿势时,如何使用openpose进行姿势自定义,以及如何通过拍摄照片或使用第三方后期软件?同时,虚幻引擎对于角色姿势的编辑也很重要,本视频就并展示了如何使用优异商城中的免费资源来创建人物角色。

2024-12-19 11:43:51

![stable diffusion初识_stable diffusion跟其他工具有什么区别]](http://www.aituku.cc/uploadfile/2024/1224/d3a1bbf8bad6e281f82a2168727dfba1.png)